Baru-baru ini, industri hiburan menghadapi krisis pertamanya karena "fabrikasi AI."

Sebelum konfirmasi apa pun dapat dilakukan, citra tersebut rusak, opini publik berubah tiba-tiba, dan aktivitas dihentikan. Dulu, rumor tidak menyebar secepat atau semengerikan sekarang. Namun, mulai sekarang,

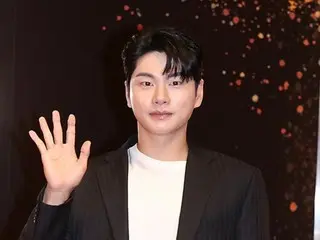

Beberapa gambar komposit telah disamarkan sebagai "bukti nyata", yang membahayakan mata pencaharian para selebritas. Aktor Lee Yi Kyung, model Moon Ga Bi, dan aktor Lee Jung Jae semuanya telah menjadi korban.

Karena kasus-kasus terus bermunculan, situasi ini tidak lagi hanya kasus satu atau dua orang yang tidak beruntung, tetapi menjadi risiko bagi seluruh industri hiburan.

Pemalsuan itu mudah terjadi, tetapi dampaknya bertahan lama... Mengapa rumor AI begitu berbahaya?

Pembuatan AI telah jauh melampaui sekadar pembuatan rumor. Contoh paling representatif adalah rumor seputar kehidupan pribadi Lee Yi Kyung. Rumor ini bermula dari sebuah unggahan di media sosial oleh seorang perempuan asing.

Kecurigaan itu dengan cepat menyebar tanpa alasan, dengan gambar, video, dan bahkan percakapan yang disintesis oleh AI. Wanita itu terlambat meminta maaf, dengan mengatakan, "Dokumen-dokumen itu direkayasa oleh AI," tetapi

Lee Yi Kyung telah dikeluarkan dari dua acara varietas. Pemalsuan itu merupakan pukulan telak, tetapi pukulan telak tersebut berdampak pada kegiatannya di masa mendatang. Namun, wanita itu baru-baru ini mengatakan, "Saya tidak dituntut."

"Saya sedang mempertimbangkan apakah akan merilis foto verifikasi. Agak aneh kalau dibiarkan seperti ini. Saya kecewa karena ini bukan AI," katanya, menimbulkan kehebohan.

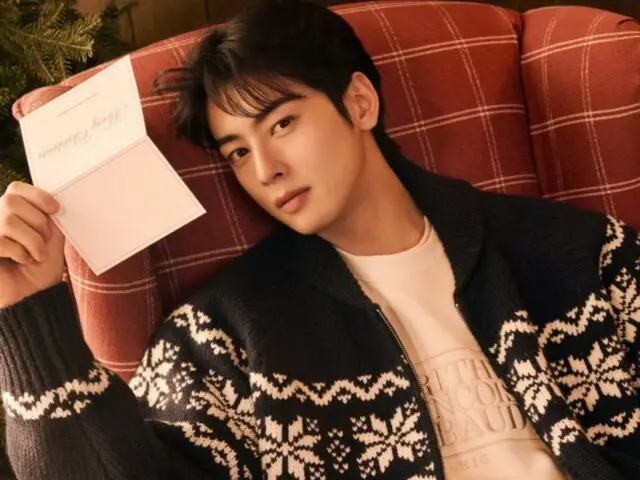

Kasus Moon GaBi serupa: begitu saya mengunggah foto anak saya dari belakang, seseorang menggunakan AI untuk membuat foto dirinya dari depan.

Ini bukan manipulasi gambar biasa, tetapi penguntitan digital yang melanggar privasi keluarga, itulah sebabnya Moon GaBi sangat marah.

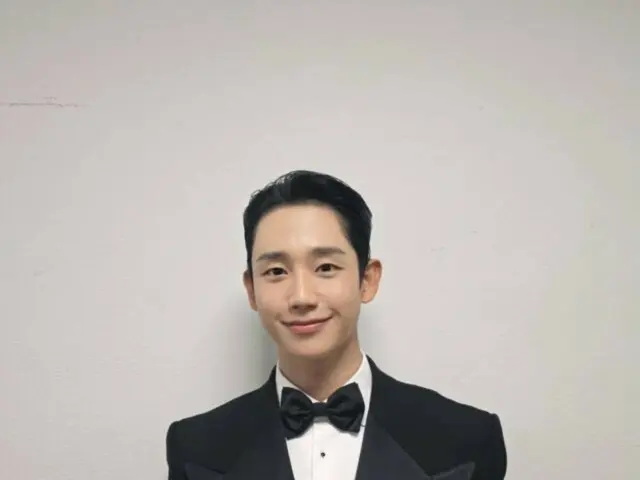

Lee Jung-jae adalah contoh korban yang lebih gamblang. Wajahnya digunakan sebagai kartu identitas AI dalam kasus penipuan asmara, yang justru berujung pada kematian.

Perusahaan artis tersebut segera mengeluarkan pernyataan yang berbunyi, "Video palsu yang wajah dan suara aktor kami telah direkayasa menggunakan teknologi AI telah beredar luas, yang jelas merupakan tindakan ilegal," dan mengancam akan mengajukan tuntutan pidana.

Kasus ini menunjukkan bahwa rekayasa AI melampaui sekadar pencemaran nama baik gambar dan dapat disalahgunakan sebagai alat kriminal.

Bagi para selebriti, "citra" mereka adalah fondasi keberadaan mereka.

Ini akan memiliki efek berkelanjutan jangka panjang pada kontrak iklan, tawaran pekerjaan di masa mendatang, kepercayaan penggemar, dan bahkan nilai merek global.

Masih terlalu dini bagi agensi bakat untuk merespons... batasan realistis yang disampaikan oleh pihak-pihak di industri ini. Industri hiburan sudah memiliki sistem yang berfokus pada tuntutan hukum dan tuduhan. Namun,

Pandangan yang berlaku adalah bahwa teknologi AI saat ini sulit untuk ditangani sendiri oleh agensi bakat. Seorang narasumber industri mengatakan, "Semua orang di industri ini menanggapi hal ini dengan sangat serius."

"Seiring konten palsu menjadi semakin canggih dan realistis, hak potret dan reputasi dirusak secara serius. Kami sedang membangun sistem litigasi dan pelaporan segera, yang berpusat pada tim hukum kami."

Namun, ia menunjukkan "keterbatasan struktural" yang dihadapi industri ini. "AI menyebar begitu cepat sehingga orang biasa dapat dengan mudah membuat konten yang mendalam."

Ini lingkungan yang sulit. Ada batasan terhadap apa yang bisa dilakukan agensi ini sendirian. Hanya dengan memberikan informasi kepada penggemar, memperkuat pemantauan platform, dan menerapkan peraturan pemerintah, kita dapat mengatasi masalah ini secara efektif.

Pernyataan ini berarti bahwa menangani DeepFei bukan hanya masalah bagi industri hiburan, tetapi masalah bagi seluruh ekosistem. Khususnya, risiko terbesarnya adalah kurangnya peran platform.

Struktur yang mendistribusikan dan menyebarluaskan konten AI telah diabaikan, dan sistem perlindungan para penghibur tetap menjadi "respons pasca-acara". Industri ini dengan suara bulat menyatakan bahwa pengaturan kelembagaan berikut sangat dibutuhkan:

▲ Tampilan wajib konten yang dihasilkan AI ▲ Sistem untuk penghapusan langsung konten yang dalam ▲ Hukuman yang lebih berat bagi pembuat dan distributor jahat ▲ Sistem pemantauan tingkat platform wajib.

Kurangnya sistem merupakan risiko yang tidak dapat diabaikan lagi, karena dapat menyebabkan kejahatan seperti kasus penipuan Lee Jung-jae.

Sistem baru untuk melindungi selebritas di era AI harus dirancang.

Masalah terbesar yang dihadapi industri hiburan adalah kurangnya "sistem respons berorientasi masa depan."

Akan tetapi, sebagian besar tindakan hanya diambil setelah kejadian, dan mereka tidak mampu mengimbangi kecepatan penyebaran kebohongan, apalagi meminimalisir kerusakan.

Secara khusus, rumor tentang platform berbasis AI menimbulkan ancaman terhadap pencitraan merek artis secara keseluruhan.

Sumber tersebut mengatakan, "Rumor tentang Deep Fei sangat menghancurkan nilai merek dan aktivitas secara keseluruhan. Rumor tersebut telah menyebabkan kerugian besar, seperti pembatalan kontrak iklan dan penghentian aktivitas. Para penggemar juga mengalami tekanan mental yang hebat."

Ia juga menyampaikan arahan spesifik untuk perbaikan, dengan mengatakan, "Penting untuk mewajibkan penayangan konten AI dan memperberat sanksi bagi mereka yang membuat dan mendistribusikannya. Saya juga berpendapat perlu untuk menciptakan sistem respons bersama dari industri."

Khususnya, pendatang baru yang dijadwalkan debut di masa mendatang, artis yang akan segera memasuki pasar global, dan para entertainer yang harus melanjutkan aktivitasnya berdasarkan kepercayaan terhadap merek mereka dalam jangka panjang, berada dalam situasi ini.

Di era rekayasa AI, AI mungkin menjadi semakin rentan. Yang dibutuhkan industri hiburan di masa depan bukanlah sistem sederhana untuk mengajukan keluhan dan tuduhan, melainkan sistem yang dapat dibangun bersama oleh platform, pemerintah, dan industri hiburan.

Ini adalah "infrastruktur untuk melindungi selebritas." Waktunya semakin dekat ketika hal ini tidak lagi mungkin ditangani sebagai masalah individual.

2025/11/19 21:03 KST

Copyrights(C) Herald wowkorea.jp 111